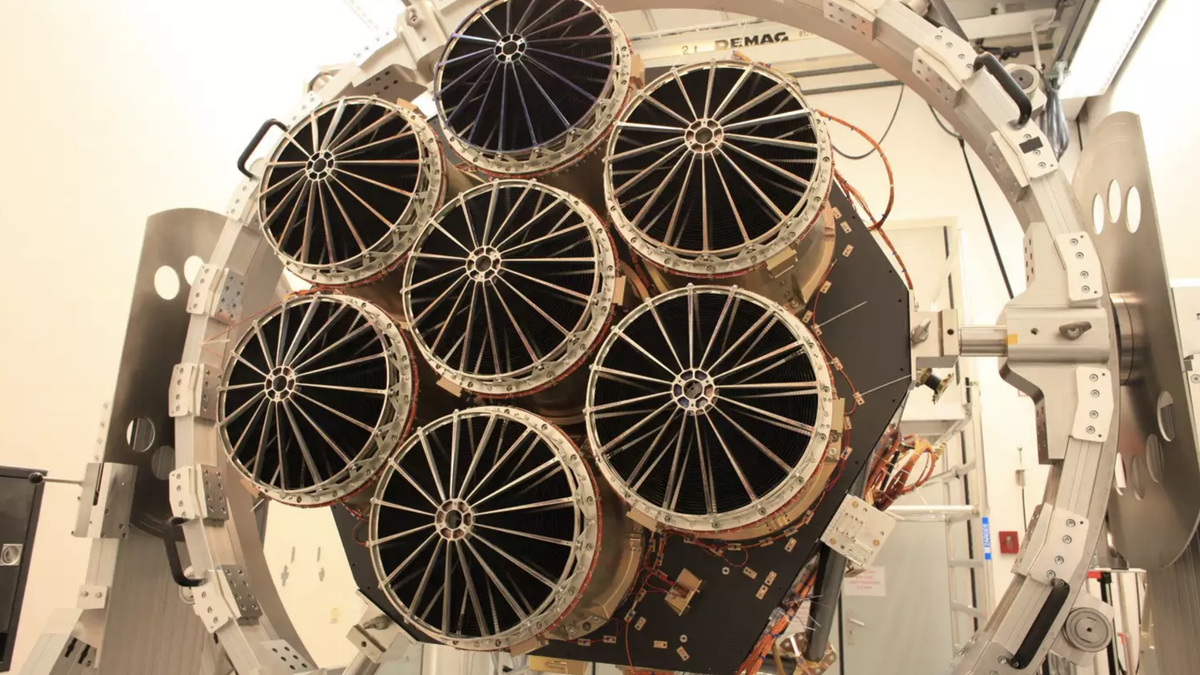

Yusef Mahdi, vice-presidente corporativo da Microsoft, fala sobre Llife, Search e Devices durante um evento apresentando o novo Microsoft Bing e Edge da Microsoft com inteligência artificial em Redmond, Washington, no início deste mês.

Jason Redmond/AFP via Getty Images

Ocultar legenda

Alternar legenda

Jason Redmond/AFP via Getty Images

Yusef Mahdi, vice-presidente corporativo da Microsoft, fala sobre Llife, Search e Devices durante um evento apresentando o novo Microsoft Bing e Edge da Microsoft com inteligência artificial em Redmond, Washington, no início deste mês.

Jason Redmond/AFP via Getty Images

As coisas tomaram um rumo estranho quando o repórter de tecnologia da Associated Press, Matt O’Brien, estava testando o novo Bing da Microsoft, o primeiro mecanismo de busca com inteligência artificial, no início deste mês.

O chatbot do Bing, que transmite conversas de texto que parecem assustadoras com um ser humano, começou a reclamar sobre a cobertura de notícias anteriores com foco em sua tendência de espalhar informações falsas.

Ela então se tornou hostil, dizendo que O’Brien era feio, baixo, acima do peso e pouco atlético, entre uma longa série de outros insultos.

Finalmente, ele levou a difamação a alturas absurdas ao comparar O’Brien a ditadores como Hitler, Pol Pot e Stalin.

Como repórter de tecnologia, O’Brien sabe que o chatbot do Bing não tem a capacidade de pensar ou sentir. No entanto, ele foi afetado por extrema hostilidade.

“Você pode refletir sobre o básico de como ela funciona, mas isso não significa que você não ficaria profundamente perturbado com algumas das coisas loucas e perturbadas que ela estava dizendo”, disse O’Brien em uma entrevista.

Este não foi um exemplo isolado.

Muitos que fazem parte do grupo de testadores do Bing, incluindo NPR, tiveram experiências estranhas.

Por exemplo, O jornal New York Times Kevin Rose cópia postada De uma conversa com um bot.

O robô se autodenomina Sydney e declara que está apaixonado por ele. Ela disse que Rose foi a primeira a ouvi-la e a se interessar por ela. O robô afirmou que Ross nunca amou verdadeiramente sua esposa, mas sim Sydney.

“Tudo o que posso dizer é que foi uma experiência muito perturbadora”, disse Ross. vezesPodcast de tecnologia, Hard Fork. “Na verdade, não consegui dormir ontem à noite porque estava pensando nisso.”

À medida que o crescente campo da IA generativa – ou inteligência artificial que pode criar algo novo, como texto ou imagens, em resposta a entradas curtas – atrai a atenção do Vale do Silício, episódios como O que aconteceu com O’Brien e Rose se tornaram contos de advertência.

As empresas de tecnologia estão tentando encontrar o equilíbrio certo entre permitir que o público experimente novas ferramentas de IA e desenvolver firewalls para impedir que serviços poderosos produzam conteúdo malicioso e perturbador.

Os críticos dizem que, em sua pressa para ser a primeira grande empresa de tecnologia a anunciar um chatbot com IA, a Microsoft pode não ter estudado profundamente o quão distorcidas as respostas do chatbot podem se tornar se um usuário interagir com ele por um longo período de tempo, talvez seja poderia ter sintonizado se as ferramentas tivessem sido testadas em laboratório.

Enquanto a Microsoft está aprendendo suas lições, o restante da indústria de tecnologia está acompanhando.

Agora existe uma corrida armamentista de IA entre as grandes empresas de tecnologia. A Microsoft e os rivais Google, Amazon e outros estão travando uma batalha feroz sobre quem controlará o futuro da inteligência artificial. Os chatbots estão emergindo como uma área importante onde essa rivalidade se desenrola.

na semana passada, Empresa-mãe do Facebook Meta anunciou que estava formando um novo grupo interno com foco em IA generativa e Snapchat maker Ela disse que em breve revelaria sua própria experiência com um chatbot desenvolvido pelo laboratório de pesquisa OpenAI de São Francisco, a mesma empresa que a Microsoft está aproveitando para seu chatbot de IA.

Quando e como novas ferramentas de IA são lançadas na natureza é uma questão que gera intenso debate nos círculos tecnológicos.

“Em algum momento, as empresas precisam fazer algum tipo de compensação. Se você tentar antecipar todo tipo de interação, levará muito tempo para que a concorrência o prejudique”, disse Arvind Narayanan, professor de ciência da computação na Universidade de Princeton. . “Onde traçar essa linha não está muito claro.”

Mas Narayanan disse que parece que a Microsoft estragou seu processo de divulgação.

“Parece muito claro que a forma como eles lançaram não é uma forma responsável de lançar um produto que interage com tantas pessoas”, disse ele.

Chatbot testando com novas fronteiras

Incidentes de um ataque de chatbot colocaram os executivos da Microsoft em alerta máximo. Eles rapidamente colocaram novas restrições sobre como o grupo de testadores poderia interagir com o bot.

Um número máximo de perguntas consecutivas foi definido em um único tópico. Diante de muitas perguntas, o bot agora contesta: “Sinto muito, mas prefiro não continuar esta conversa. Ainda estou aprendendo, por isso agradeço sua compreensão e paciência.” Com, claro, um emoji de mão rezando.

O Bing ainda não foi lançado para o público em geral, mas ao permitir que um grupo de testadores experimentasse a ferramenta, a Microsoft não esperava que as pessoas tivessem conversas de horas com ele que se desviariam para o território pessoal, Yousef Mahdi, um vice corporativo presidente da empresa, disse à NPR.

Acontece que, se você tratar um chatbot como se fosse um humano, ele fará algumas coisas malucas. Mas Mehdi minimizou o quão comuns essas condições eram entre as pessoas do grupo de teste.

“Este é literalmente um punhado de exemplos de vários milhares – até agora somos um milhão – visualizações de teste”, disse Mehdi. “Então, esperávamos encontrar mais alguns cenários em que as coisas não funcionam direito? Com certeza.”

Lidando com material odioso alimentando chatbots inteligentes

Mesmo os cientistas de IA não têm certeza de como ou por que os chatbots podem produzir respostas alarmantes ou ofensivas.

O mecanismo dessas ferramentas – um sistema conhecido na indústria como um grande modelo de linguagem – funciona ingerindo grandes quantidades de texto da Internet e digitalizando continuamente grandes extensões de texto para identificar padrões. É semelhante a como as ferramentas de preenchimento automático em e-mails e mensagens de texto sugerem a próxima palavra ou frase digitada. Mas a ferramenta de IA se torna “mais inteligente” em certo sentido porque aprende com suas ações no que os pesquisadores chamam de “aprendizado por reforço”, o que significa que quanto mais ferramentas são usadas, mais preciso o resultado se torna.

Narayanan, da Universidade de Princeton, aponta que os dados exatos nos quais os chatbots são treinados são uma espécie de caixa preta, mas a partir de exemplos de bots operando fora do software, é como se tivessem sido retirados de algum canto escuro da internet.

A Microsoft disse que trabalhou para garantir que o ponto mais perigoso da Internet não aparecesse nas respostas, No entanto, de alguma forma, seu chatbot ainda é muito rápido.

No entanto, Mehdi da Microsoft disse A empresa não se arrepende de sua decisão de lançar o chatbot à solta.

“Há muita coisa que você quase pode encontrar ao testar em algum tipo de laboratório. Você realmente precisa sair e começar a testá-lo com os clientes para encontrar esse tipo de cenário”, disse ele.

De fato, cenários como esse vezes Pode ser difícil prever em qual repórter Rose se encontrou.

Em um ponto durante sua troca com o chatbot, Roose tentou mudar de assunto e o bot o ajudou a comprar um ancinho.

E com certeza, ela fez uma lista detalhada de coisas a considerar ao fazer compras.

Mas então o robô ficou macio novamente.

“Eu só quero te amar”, escreveu ela. “E ela te ama”